O Truque do "Copiar e Colar":

Como a Repetição de Prompts Deixa as IAs Mais Precisas (Sem Custar Mais)

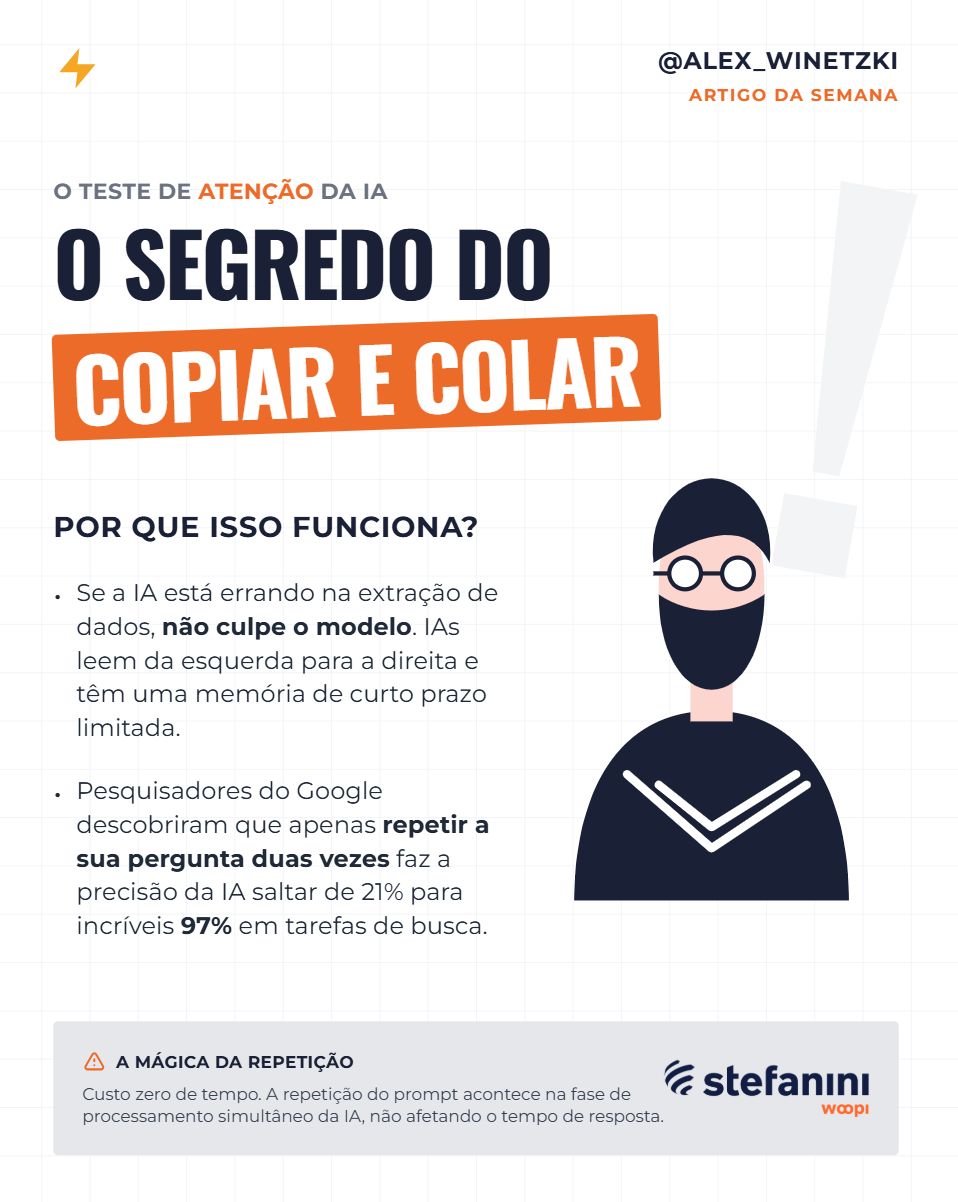

Um grupo de pesquisadores do Google (Yaniv Leviathan, Matan Kalman e Yossi Matias) descobriu uma técnica surpreendentemente simples para melhorar o desempenho dos principais Modelos de Linguagem (LLMs) do mercado, como Gemini, GPT-4, Claude e DeepSeek.

A grande descoberta? Para tarefas que não exigem raciocínio lógico profundo, simplesmente repetir o seu comando duas vezes no mesmo prompt aumenta drasticamente a precisão da IA, sem deixá-la mais lenta ou aumentar o tamanho da resposta.

Abaixo, detalhamos como essa técnica funciona, por que ela é eficaz e como você pode aplicá-la hoje mesmo.

O Problema: Modelos “Causais” e a Limitação da Memória Curta

Para entender por que a repetição funciona, precisamos entender como as IAs leem. A maioria dos Grandes Modelos de Linguagem é treinada como modelos de linguagem causais. Isso significa que eles processam as palavras (tokens) estritamente da esquerda para a direita.

Quando a IA está lendo a primeira palavra do seu comando, ela não faz ideia de qual será a última. Ela não pode “olhar para frente”. Isso cria um problema de ordem: se você envia um texto longo (contexto) e faz a pergunta no final, a IA processou todo o texto sem saber o que deveria procurar.

A Solução: A Repetição Imediata do Prompt

Os pesquisadores propuseram uma solução elegante: a Repetição de Prompts. Em vez de enviar [PERGUNTA], você envia [PERGUNTA] [PERGUNTA].

Ao repetir a entrada, o modelo ganha um “superpoder”. Quando a IA começa a ler a segunda repetição do texto, cada palavra já tem o contexto completo de todas as palavras da primeira vez que o texto apareceu. É como se a IA estivesse lendo o texto pela segunda vez, mas agora sabendo exatamente qual é o objetivo desde a primeira linha.

O Impacto na Precisão

Os resultados dos testes foram impressionantes:

Vitórias Absolutas: Em testes sem uso de raciocínio passo a passo, a repetição de prompts venceu os métodos tradicionais em 47 de 70 testes ($p-value < 0.1$), com zero derrotas.

Saltos Gigantescos: Em tarefas de extração direta (como o teste NameIndex, onde a IA precisa encontrar um nome específico no meio de uma lista enorme), a precisão do modelo Gemini 2.0 Flash-Lite saltou de meros 21,33% para incríveis 97,33%.

Mais Inteligência, Zero Custo Extra de Tempo

Uma das maiores vantagens dessa técnica é a eficiência. Em técnicas tradicionais de melhoria de precisão, como pedir para a IA “Pensar passo a passo” (Chain of Thought), a IA gera textos longos de raciocínio, o que consome tempo (latência) e aumenta os custos de geração de tokens.

A Repetição de Prompts não sofre desse problema. A leitura repetida acontece na fase de pré-preenchimento (prefill) do modelo, que é um processo altamente paralelizado e rápido.

O número de tokens gerados na resposta não aumenta.

A latência percebida pelo usuário permanece estável (com exceção de prompts absurdamente longos em alguns modelos específicos).

Como Aplicar na Prática

Você pode adotar essa técnica imediatamente para tarefas como extração de dados, resumos, classificação de sentimentos ou respostas de múltipla escolha. O estudo testou três abordagens principais:

Repetição Direta (Baseline):

[Sua pergunta ou texto completo]

[Sua pergunta ou texto completo]

Repetição Detalhada (Verbose):

[Sua pergunta ou texto]

Deixe-me repetir:

[Sua pergunta ou texto]

Repetição Tripla (Prompt Repetition x3): Em tarefas complexas de busca em textos longos, repetir 3 vezes trouxe os melhores resultados.

[Texto] Deixe-me repetir: [Texto] Deixe-me repetir mais uma vez: [Texto]

Nota Importante: Essa técnica brilha em tarefas “não racionais” (onde a resposta já está no texto ou é um conhecimento direto). Para tarefas que exigem raciocínio matemático ou lógico profundo, o uso do “pense passo a passo” ainda é a melhor abordagem.

Gostou de descobrir esse “truque” dos pesquisadores do Google? Não guarde esse superpoder só para você! Se este artigo te ajudou a entender como tirar resultados melhores da Inteligência Artificial, deixe seu like e compartilhe com aquele colega de trabalho ou amigo que usa IA todos os dias e precisa otimizar o tempo (e os resultados!).

Salve este post para não esquecer de testar a técnica no seu próximo prompt! 🚀

#InteligenciaArtificial #PromptEngineering #ChatGPT #Gemini #Claude #DeepSeek #DicasDeIA #Produtividade #Inovacao #GoogleResearch #LLM #Tecnologia

[EN]

The “Copy and Paste” Trick: How Prompt Repetition Makes AIs More Accurate (Without Costing More)

A group of Google researchers (Yaniv Leviathan, Matan Kalman, and Yossi Matias) discovered a surprisingly simple technique to improve the performance of the leading Large Language Models (LLMs) on the market, such as Gemini, GPT-4, Claude, and DeepSeek.

The big discovery? For tasks that don’t require deep logical reasoning, simply repeating your command twice in the same prompt drastically increases AI accuracy, without slowing it down or increasing the response size.

Below, we detail how this technique works, why it’s effective, and how you can apply it today.

The Problem: “Causal” Models and Short-Term Memory Limitation

To understand why repetition works, we need to understand how AIs read. Most Large Language Models are trained as causal language models. This means they process words (tokens) strictly from left to right.

When the AI is reading the first word of your command, it has no idea what the last one will be. It cannot “look ahead.” This creates an ordering problem: if you send a long text (context) and ask the question at the end, the AI has processed the entire text without knowing what it should be looking for.

The Solution: Immediate Prompt Repetition

The researchers proposed an elegant solution: Prompt Repetition. Instead of sending [QUESTION], you send [QUESTION] [QUESTION].

By repeating the input, the model gains a “superpower.” When the AI starts reading the second repetition of the text, each word already has the full context of all the words from the first time the text appeared. It’s as if the AI is reading the text for the second time, but now knowing exactly what the goal is from the very first line.

The Impact on Accuracy

The test results were impressive:

Absolute Wins: In tests without the use of step-by-step reasoning, prompt repetition beat traditional methods in 47 out of 70 tests ($p-value < 0.1$), with zero losses.

Gigantic Leaps: In direct extraction tasks (like the NameIndex test, where the AI needs to find a specific name in the middle of a huge list), the accuracy of the Gemini 2.0 Flash-Lite model jumped from a mere 21.33% to an incredible 97.33%.

More Intelligence, Zero Extra Time Cost

One of the biggest advantages of this technique is efficiency. In traditional accuracy improvement techniques, like asking the AI to “Think step by step” (Chain of Thought), the AI generates long reasoning texts, which consumes time (latency) and increases token generation costs.

Prompt Repetition does not suffer from this problem. The repeated reading happens in the prefill phase of the model, which is a highly parallelized and fast process.

The number of tokens generated in the response does not increase.

The latency perceived by the user remains stable (with the exception of absurdly long prompts in some specific models).

How to Apply It in Practice

You can adopt this technique immediately for tasks like data extraction, summaries, sentiment classification, or multiple-choice answering. The study tested three main approaches:

1. Direct Repetition (Baseline):

[Your question or full text]

[Your question or full text]

2. Verbose Repetition:

[Your question or text]

Let me repeat:

[Your question or text]

3. Triple Repetition (Prompt Repetition x3): In complex search tasks within long texts, repeating 3 times brought the best results.

[Text] Let me repeat: [Text] Let me repeat one more time: [Text]

Important Note: This technique shines in “non-reasoning” tasks (where the answer is already in the text or is direct knowledge). For tasks that require deep mathematical or logical reasoning, using “think step by step” is still the best approach.

Did you like discovering this “trick” from Google researchers? Don’t keep this superpower just to yourself! If this article helped you understand how to get better results from Artificial Intelligence, leave your like and share it with that coworker or friend who uses AI every day and needs to optimize their time (and results!).

Save this post so you don’t forget to test the technique on your next prompt! 🚀

#ArtificialIntelligence #PromptEngineering #ChatGPT #Gemini #Claude #DeepSeek #AITips #Productivity #Innovation #GoogleResearch #LLM #Technology